Colombia

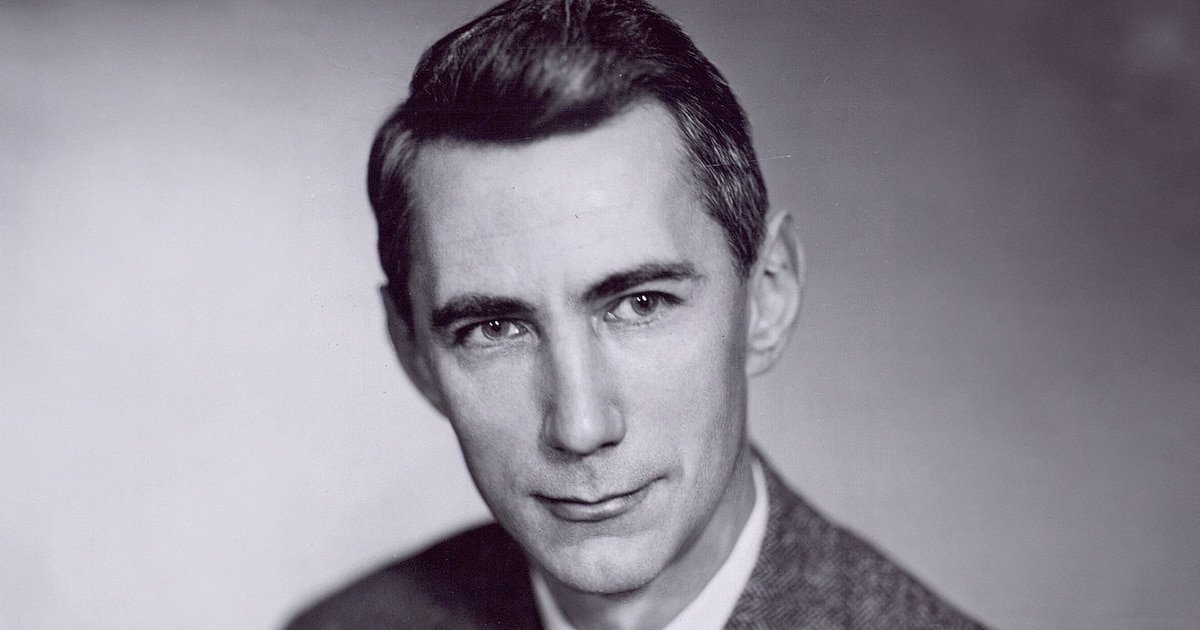

Claude Shannon: El Visionario que Revolucionó la Tecnología Moderna con su Teoría de la Información

Claude Elwood Shannon vino al mundo el 30 de abril de 1916 en Petoskey, Michigan. Desde su infancia, demostró una sed insaciable de entendimiento por los dispositivos a su alrededor. Durante su niñez, no solo restauraba radios, sino que también diseñaba juguetes y realizaba experimentos con los componentes tecnológicos presentes en su entorno.

Su pasión por la ingeniería y las matemáticas lo guiaría a construir una trayectoria que alteraría el rumbo de la historia en los campos de la computación y las telecomunicaciones.

De acuerdo con Spectrum, en su niñez y adolescencia, ya era evidente que la mente de Shannon sobrepasaba lo convencional.

Shannon se formó en ingeniería eléctrica y matemáticas en la Universidad de Michigan, y posteriormente en la Universidad de Princeton, donde amplió sus estudios y alcanzó su doctorado en matemáticas en 1940.

Durante su estancia en Princeton, elaboró una disertación doctoral que modificaría permanentemente la teoría de los circuitos eléctricos.

En su obra titulada “Un análisis simbólico de los circuitos de relés y de conmutación”, Shannon utilizó la lógica booleana, formulada por el matemático británico George Boole, para representar operaciones matemáticas en circuitos eléctricos.

Esta disertación, presentada en 1937, fue tan influyente que muchos especialistas la consideran la más relevante de todos los tiempos.

Su hallazgo estableció los cimientos para la programación informática y solidificó las bases de la computación digital tal como la conocemos hoy en día.

Después de conseguir su doctorado, Shannon se integró a los Laboratorios Bell, donde su labor lo llevó a desarrollar la teoría matemática de la criptografía durante el conflicto mundial.

En ese contexto, Shannon transformó la criptografía, que hasta ese momento era un arte, en una disciplina rigurosa, formulando teorías que posibilitaban codificar y decodificar mensajes de manera segura y precisa.

Según Spectrum, uno de sus logros más significativos en este campo fue el artículo “Una teoría matemática de la criptografía”, en el que presentó métodos para resguardar los mensajes digitales utilizando claves y códigos, esenciales para la comunicación contemporánea.

Sin embargo, su contribución más importante a la ciencia llegó con la publicación de su artículo “A Mathematical Theory of Communication” en 1948.

En este trabajo, dio a conocer su teoría de la información, que se volvería crucial para la comprensión actual de la transmisión de datos.

Introdujo el concepto de “entropía de la información”, tomado de la física, que se refiere a la incertidumbre o imprevisibilidad de los datos transmitidos por un canal de comunicación.

Shannon también definió el “bit” como la unidad elemental de información, una unidad binaria de 0 o 1 que se convertiría en el componente fundamental de toda computación digital.

Aunque su obra era valorada en el ámbito académico, Shannon nunca ambicionó la popularidad. De hecho, a lo largo de su carrera,se mantuvo distante de la exposición pública. Como indica Rob Goodman, coautor de la biografía A Mind at Play, Shannon prefería laborar en el anonimato, enfocándose en resolver problemas difíciles y en la creación de nuevos dispositivos.

Uno de sus inventos más peculiares fue el “ratón mecánico” denominado “Theseus”, un aparato capaz de encontrar su camino a través de un laberinto utilizando prueba y error, siendo uno de los primeros ejemplos de lo que hoy se conoce como inteligencia artificial.

Además, diseñó una máquina para jugar ajedrez, entre otros inventos que, aunque no siempre resultaban funcionales, demostraban su excepcional habilidad para resolver problemas mediante la tecnología.

Shannon también era reconocido por su sentido del humor y su carácter excéntrico.

Según sus compañeros, quienes conversaron con la revista Spectrum, solía pasear por los corredores de los Laboratorios Bell montado en un monociclo mientras hacía malabares con cuatro pelotas. Esta actitud lúdica contrastaba con la seriedad de su labor intelectual y era una expresión de su modo singular de interactuar con el entorno.

Durante las décadas de 1950 y 1960, Shannon siguió desarrollando innovaciones tecnológicas, muchas de las cuales anticipaban avances que no se concretarían hasta varias décadas después.

Entre estos aparatos se encontraba una “máquina que leía la mente”, y una calculadora que empleaba números romanos para llevar a cabo cálculos.

A pesar de su escaso interés por las aplicaciones prácticas de sus invenciones, su capacidad para concebir dispositivos complejos y entretenidos jamás dejó de asombrar a sus colegas.

“Hago lo que me resulta natural y la utilidad no es mi objetivo primordial”, afirmaba Shannon, lo que resalta su enfoque particular hacia la ciencia y la tecnología.

Shannon falleció el 24 de febrero de 2001 a los 84 años, dejando un legado monumental que persiste en la tecnología actual. Su trabajo sobre la teoría de la información ha sido fundamental para el desarrollo de internet, las comunicaciones móviles, las computadoras y todos los sistemas que transmiten datos.